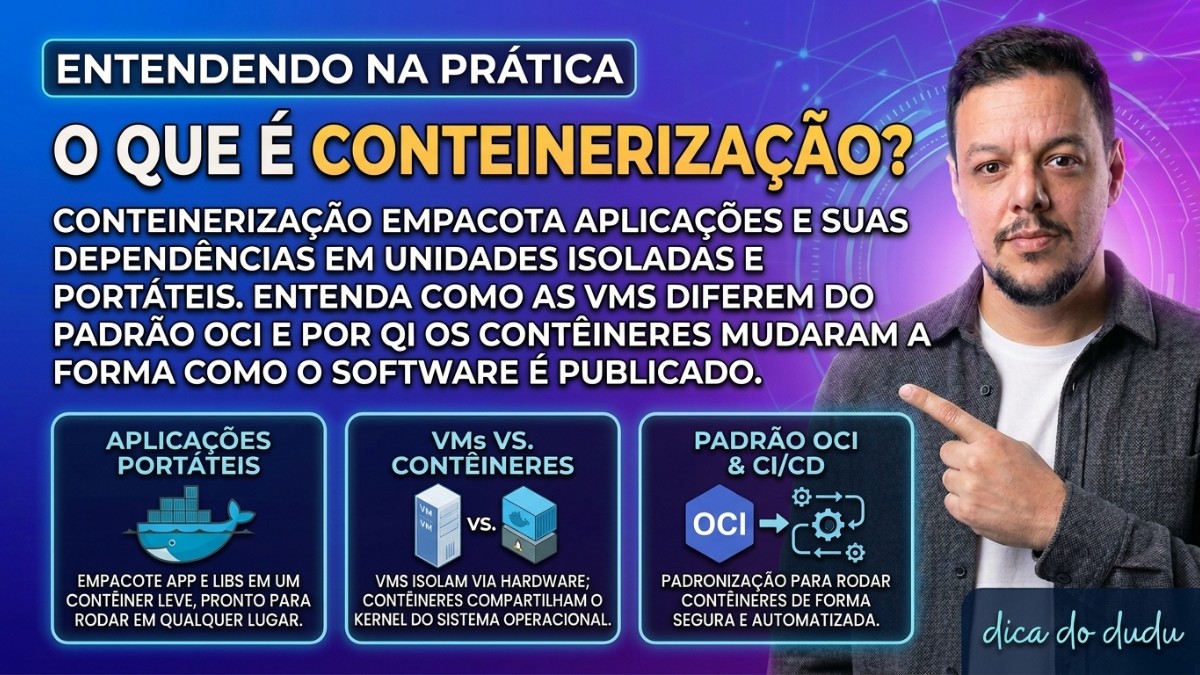

O que e Conteinerização?

Empacotar aplicações com todas as dependências em unidades isoladas e portáteis.

Conteinerização e a técnica de empacotar uma aplicação junto com todas as suas dependências, bibliotecas, runtime, configurações, variáveis de ambiente, em uma unidade isolada chamada container. Esse container pode ser executado em qualquer ambiente que tenha um container runtime instalado, independente do sistema operacional do host ou das dependências instaladas na máquina. A Conteinerização resolve o problema clássico de inconsistência entre ambientes de desenvolvimento, staging e produção. Ela permite que equipes de desenvolvimento entreguem software de forma mais rápida, consistente e confiável, sendo a base do movimento DevOps e das arquiteturas de microservicos modernas.

Como containers funcionam internamente

Containers usam namespaces e cgroups do kernel Linux para criar isolamento leve.

Containers não são magia, são processos Linux com isolamento aplicado atraves de features nativas do kernel. Namespaces isolam o que o processo pode ver: PID namespace isola a árvore de processos, network namespace isola a rede, mount namespace isola o sistema de arquivos, UTS namespace isola o hostname. cgroups limitam o que o processo pode usar: CPU, memória, I/O de disco e rede. Juntas, essas tecnologias criam a ilusão de um ambiente isolado sem a sobrecarga de virtualizar hardware completo. O resultado e um container que inicia em milissegundos, usa megabytes de overhead em vez de gigabytes e pode coexistir com dezenas de outros containers no mesmo host sem interferência.

Container vs Máquina Virtual em profundidade

VMs emulam hardware completo. Containers isolam processos no mesmo kernel.

Uma máquina virtual roda um hypervisor que emula hardware fisico. Sobre esse hardware virtual sobe um sistema operacional completo com seu próprio kernel, drivers e sistema de arquivos. Isso oferece isolamento total, um VM comprometido não afeta o host nem outros VMs. Containers compartilham o kernel do host, o que significa isolamento mais fraco pois uma vulnerabilidade no kernel pode afetar todos os containers. Na prática, para a maioria das cargas de trabalho o trade-off e favorável: containers iniciam em segundos, usam fração dos recursos de uma VM e permitem density muito maior por servidor. Muitas empresas combinam os dois: VMs para isolamento forte de clientes diferentes, containers dentro das VMs para densidade de aplicações.

O padrão OCI

A Open Container Initiative garante interoperabilidade entre diferentes ferramentas de container.

A Open Container Initiative (OCI) e uma organização criada em 2015 pela Linux Foundation com o objetivo de padronizar o formato de containers e os runtimes que os executam. Sem o OCI, containers criados com Docker poderiam não ser compatíveis com outros runtimes. O OCI define duas específicações principais: a Image Spec (como uma image de container e estruturada e armazenada) e a Runtime Spec (como um container deve ser criado e executado a partir de uma image). Gracias ao OCI, uma image buildada com Docker pode ser executada por containerd, podman, CRI-O ou qualquer outro runtime compatível. Isso elimina o lock-in em ferramentas específicas e permite que o ecossistema evolua com múltiplas implementações competindo.

Container runtimes

O software que efetivamente cria e executa containers no host.

O container runtime e o software que pega uma image OCI e cria um container em execução. O Docker usa containerd internamente como seu runtime de baixo nível. O containerd e hoje o runtime mais amplamente usado, e o padrão no Kubernetes desde que o suporte nativo ao Docker (dockershim) foi removido na versão 1.24. O CRI-O e outro runtime usado no Kubernetes, desenvolvido pela Red Hat. O runc e o runtime de referência do OCI, implementa a OCI Runtime Spec e e usado por containerd e CRI-O como runtime de baixo nível. Para o desenvolvedor do dia a dia, o runtime e transparente. Para equipes de operações e SRE, entender qual runtime esta em uso e importante para troubleshooting e configuração de segurança.

Container registries

Serviços para armazenar e distribuir images de container entre ambientes.

Um container registry e um serviço de armazenamento e distribuição de images. O Docker Hub e o mais famoso e contem milhares de images oficiais e públicas. Para imagens privadas de empresas, as opções mais usadas são: GitHub Container Registry (ghcr.io), integrado ao GitHub Actions; Amazon ECR (Elastic Container Registry), integrado com serviços AWS; Google Artifact Registry, integrado com GKE; Azure Container Registry. O fluxo padrão e: CI/CD builda a image, faz push para o registry com uma tag (geralmente o git commit SHA), e o sistema de deploy instrui os servidores a fazer pull dessa tag específica. Tags imutáveis (nunca sobrescrever latest em produção) são prática essencial para deploys confiáveis e rollbacks seguros.

Orquestração de containers

Kubernetes gerência automaticamente onde e como containers rodam em produção.

Em produção com múltiplos servidores, gerenciar containers manualmente não escala. Orquestradores automatizam: decidir em qual servidor rodar cada container, reiniciar containers que falharam, escalar horizontalmente baseado em carga, fazer rolling updates sem downtime, gerenciar configurações e secrets, e balancear tráfego entre instâncias. O Kubernetes e o padrão da industria para orquestração, originalmente desenvolvido pelo Google e open source desde 2014. Alternativas mais simples incluem Docker Swarm (integrado ao Docker) e Nomad (da HashiCorp). Para a maioria das empresas hoje, Kubernetes e a escolha para ambientes de produção de medio e grande porte, frequentemente gerenciado via serviços como GKE, EKS ou AKS.

Imutabilidade de containers

Containers não devem ser modificados em produção, a mudanca vem de uma nova image.

Um princípio fundamental de containers em produção e a imutabilidade. Um container em execução não deve ser modificado, nenhum SSH para instalar pacotes, nenhuma edição de arquivos de configuração dentro do container rodando. Quando uma mudanca e necessária, o processo correto e: fazer a mudanca no Dockerfile ou na configuração, buildar uma nova image, e deployar a nova image substituindo a antiga. Esse princípio garante que o estado de produção seja sempre reproduzível a partir do código no repositório. Containers modificados manualmente criam snowflakes, servidores únicos que não podem ser recriados, um dos maiores problemas operacionais em infraestrutura tradicional que containers resolvem quando usados corretamente.

Quando containers adicionam valor real

Microservicos, ambientes múltiplos e pipelines de CI/CD são onde containers brilham.

Containers adicionam mais valor em cenários específicos. Microservicos se beneficiam enormemente: cada serviço tem sua própria image, pode ser deployado independentemente e escalado de forma granular. Times com múltiplos ambientes (dev, staging, prod) eliminam inconsistências, a mesma image vai por todos os ambientes. Pipelines de CI/CD ficam mais confiáveis porque testes rodam no mesmo container que vai para produção. Aplicações poliglotas (serviços em Node, Python, Go no mesmo sistema) coexistem sem conflitos de dependência. Para uma aplicação monolitica simples sem necessidade de múltiplos ambientes, o ganho pode não justificar a complexidade adicional. A decisão de containerizar deve ser baseada nos problemas reais que a equipe enfrenta.

Resumo final

Conteinerização e a fundação do desenvolvimento de software moderno em escala.

Conteinerização mudou como software e desenvolvido, testado e publicado. Ao empacotar aplicações com todas as suas dependências em unidades portáteis e reproduzíveis, containers eliminaram classes inteiras de bugs de ambiente e aceleraram ciclos de deploy. O padrão OCI garantiu interoperabilidade entre ferramentas, runtimes e plataformas. O Kubernetes tornou possível operar centenas de containers em produção com confiabilidade. Entender Conteinerização não e mais uma habilidade avançada, e conhecimento básico esperado de qualquer desenvolvedor ou profissional de infraestrutura que trabalha com sistemas modernos. O investimento em aprender o ecossistema de containers se paga rapidamente em produtividade e confiabilidade.

Tutoriais em Video

Kubernetes Explained in 100 Seconds, Fireship

Kubernetes Crash Course for Absolute Beginners, TechWorld with Nana

What is a Container?, IBM Technology

Containerization Explained, IBM Technology

Virtual Machines vs Docker Containers

Virtual Machine (VM) vs Docker

Conceitos-chave

Conteinerização

Técnica de empacotar aplicações com todas as dependências em unidades isoladas e portáteis

OCI

Open Container Initiative, padrão aberto para formato de container e runtime, garante interoperabilidade entre Docker Podman containerd

Container runtime

Software que executa containers, Docker usa containerd internamente; Kubernetes usa containerd ou CRI-O

Container registry

Serviço para armazenar e distribuir images, Docker Hub GitHub Container Registry Amazon ECR

Orquestração

Gerenciar múltiplos containers em produção, scaling health checks rolling updates, Kubernetes e o padrão

Imutabilidade de containers

Containers não devem ser modificados em produção, para mudar buildar nova image e deployar

Conteinerização no Instagram

@bytebytego

Reels, Conteinerização

@bytebytego

Conteinerização no Facebook

Conteinerização no X (Twitter)

O que devs dizem

Migrar para containers foi a melhor decisão de infraestrutura que tomamos. Antes cada servidor era um snowflake cheio de configurações manuais. Agora tudo e reproduzível a partir do Dockerfile e do docker-compose. Rollback em segundos.

O padrão OCI foi crucial para não ficarmos presos ao Docker. Migramos para Podman no CI/CD sem mudar uma linha de Dockerfile ou uma instrução de build. Interoperabilidade real na prática.

Imutabilidade de containers mudou minha cabeça sobre operações. Antes eu entrava no servidor para corrigir coisa. Agora a correção vai no código, gera nova image e o deploy substitui. Auditoria completa no git. Muito mais confiável.