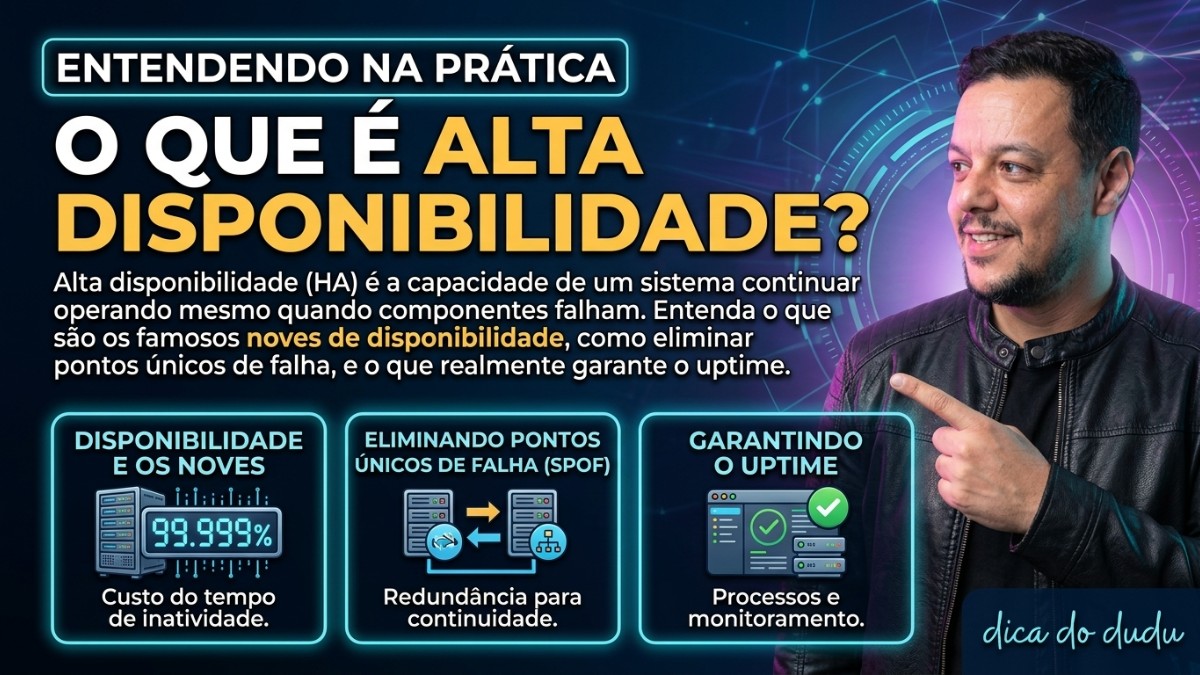

O que e Alta Disponibilidade?

A capacidade do sistema de permanecer operacional mesmo quando partes dele falham.

Alta disponibilidade, ou HA (High Availability), e a propriedade de um sistema de continuar funcionando de forma continua por um longo período de tempo, resistindo a falhas de componentes individuais sem interromper o serviço. Sistemas de alta disponibilidade são projetados com a premissa de que falhas vao acontecer: servidores vao travar, discos vao falhar, redes vao ter interrupções. Em vez de tentar prevenir todas as falhas (impossível), HA se concentra em fazer o sistema se recuperar automaticamente e rapidamente de falhas inevitáveis. A disponibilidade e medida em porcentagem de uptime ao longo do tempo, e os famosos "noves de disponibilidade" definem os padrões de tolerância a interrupção que diferentes tipos de sistemas exigem.

Os noves de disponibilidade

99.9% parece bom até você calcular que são 8 horas de downtime por ano.

A disponibilidade e expressa em porcentagem anual. 99% (dois noves) = 87.6 horas de downtime por ano. 99.9% (tres noves) = 8.7 horas por ano. 99.99% (quatro noves) = 52 minutos por ano. 99.999% (cinco noves) = 5 minutos por ano. Para entender o impacto: um e-commerce com 99.9% de disponibilidade tem 8.7 horas fora do ar por ano. Se o pico de vendas for exatamente nesse período, o impacto pode ser devastador. Para sistemas críticos como saude, financeiro e comunicações de emergência, cinco noves ou mais podem ser requeridos. Para a maioria dos sistemas comerciais, quatro noves (52 minutos de downtime por ano) e um target razoável que exige arquitetura redundante mas não e extremamente caro.

Eliminando pontos únicos de falha

Qualquer componente sem redundância e uma bomba-relogio esperando para explodir.

O primeiro passo para alta disponibilidade e identificar e eliminar pontos únicos de falha (SPOF - Single Point of Failure). Um SPOF e qualquer componente cuja falha derruba todo o sistema. Exemplos clássicos: um único servidor de banco de dados sem réplica, um único servidor de aplicação sem load balancer, um único DNS sem failover, um único link de internet sem redundância. A solução para cada SPOF e redundância: ter pelo menos dois de cada componente crítico, preferencialmente em zonas de disponibilidade diferentes. A regra geral e: se a falha de um único componente derruba o sistema, ele e um SPOF e precisa ser eliminado. Ferramentas de chaos engineering como o Chaos Monkey da Netflix ajudam a identificar SPOFs ao simular falhas aleatorias em produção.

Arquiteturas Active-Passive e Active-Active

Modo quente-frio e modo quente-quente tem tradeoffs diferentes de complexidade e disponibilidade.

Existem dois modelos principais de redundância. Active-Passive (Hot-Cold): um servidor primário ativo recebe todo o tráfego enquanto um secundário fica em standby. Se o primário falhar, o secundário assume (failover). E mais simples mas o failover pode levar alguns segundos a minutos, causando interrupção breve. Active-Active (Hot-Hot): dois ou mais servidores recebem tráfego simultaneamente. Se um falhar, o load balancer redireciona tudo para os outros sem interrupção perceptível. E mais complexo de implementar (especialmente para bancos de dados, que precisam resolver conflitos de escrita) mas oferece disponibilidade superior e uso mais eficiente dos recursos, pois os servidores em standby nunca ficam ociosos.

Exemplo prático: banco de dados com alta disponibilidade

Primary-réplica com failover automático e o padrão mínimo para dados críticos.

Para um banco de dados crítico com alta disponibilidade, a configuração mínima e primary-réplica com failover automático. O servidor primário recebe todas as escritas e le-as. A réplica recebe cópias continuas das mudancas do primário e aceita apenas leituras. Se o primário falhar, o sistema de failover (como Patroni para PostgreSQL ou AWS RDS Multi-AZ) detecta a falha em segundos e promove automaticamente a réplica para primário. O cliente reconecta ao novo primário sem intervenção humana. Para dados ainda mais críticos, configurar réplicas em zonas de disponibilidade diferentes (ou até regiões diferentes) protege contra falhas de datacenter inteiro. A sincronização pode ser síncrona (dados nunca perdidos, mas latência maior) ou assíncrona (menor latência, mas risco de perder alguns dados em caso de falha).

Health checks e monitoramento

Detectar falhas automaticamente e o que permite auto-recuperação em segundos.

Alta disponibilidade depende de detecção rápida de falhas. Health checks são verificações periodicas que os load balancers e orquestradores (como Kubernetes) fazem para determinar se uma instância esta saudável. Se uma instância falha nos health checks, ela e automaticamente removida da rotação e o tráfego e redirecionado para as instâncias saudáveis. Health checks bem projetados verificam não apenas se o processo esta rodando, mas se esta realmente funcionando: consegue conectar ao banco de dados, responde dentro do tempo esperado e retorna resultados validos. O monitoramento continuo de métricas como CPU, memória, latência e taxa de erros permite detectar degradação de performance antes que se torne uma falha completa.

Circuit Breaker

Um fusível para chamadas externas que previne falhas em cascata.

Circuit Breaker e um padrão de resiliência que protege o sistema contra falhas em cascata quando um serviço dependente esta com problemas. Funciona como um fusível eletrico: quando um serviço externo começa a falhar repetidamente, o circuit breaker "abre" e passa a retornar erros imediatamente sem tentar conectar ao serviço, dando tempo para ele se recuperar. Após um timeout, o circuit breaker entra em modo "half-open" e testa com uma requisição. Se o serviço recuperou, o circuit breaker "fecha" e volta ao normal. Se ainda falha, continua aberto. Isso evita que falhas de um serviço downstream (lento ou com erro) bloqueiem threads e recursos do serviço upstream, causando uma cascata que derruba todo o sistema. Hystrix (Netflix) e Polly (.NET) são implementações populares.

Disaster Recovery e RTO/RPO

Quanto tempo para recuperar e quanto dado pode ser perdido definem o nível de HA necessário.

Disaster Recovery (DR) vai além da HA local: e o plano para recuperar o sistema de falhas catastroficas como incendio no datacenter ou falha de regiao inteira de cloud. Duas métricas definem o nível de DR necessário. RTO (Recovery Time Objective): quanto tempo máximo o sistema pode ficar fora do ar antes de recuperar. Horas? Minutos? Segundos? RPO (Recovery Point Objective): qual e a perda maxima de dados aceitável? Pode perder até 1 hora de transações? 1 minuto? Nada? Quanto menor o RTO e o RPO, mais complexa e cara e a arquitetura necessária. Backup diário com restore manual pode ter RTO de horas e RPO de 24h. Replicação ativa para outra regiao pode ter RTO de segundos e RPO de zero.

Chaos Engineering

Provocar falhas propositalmente em produção para descobrir fraquezas antes que acontecam de verdade.

Chaos engineering e a prática de intencionalmente injetar falhas em sistemas de produção para testar sua resiliência. A Netflix ficou famosa pelo Chaos Monkey, uma ferramenta que aleatoriamente encerrava instâncias em produção para forcar o time a construir sistemas resilientes. O princípio e que e melhor descobrir uma fraqueza em um teste controlado do que durante um incidente real. Chaos engineering vai além de testes de carga: simula falhas de rede, latência artificial, falhas de dependências externas e até falhas de datacenter completo. Ferramentas como Gremlin, Litmus (Kubernetes) e AWS Fault Injection Simulator permitem realizar esses experimentos de forma controlada, com limites definidos e capacidade de rollback rápido se algo sair errado.

Resumo final

Alta disponibilidade não e um produto a comprar, e uma propriedade a construir camada por camada.

Alta disponibilidade e resultado de decisões arquiteturais conscientes e sistematicas: eliminar pontos únicos de falha, implementar redundância em todos os níveis críticos, monitorar de forma proativa, automatizar a recuperação de falhas e testar a resiliência regularmente. Não há uma única técnica que garanta HA: e a soma de load balancing, health checks, circuit breakers, réplicas de banco de dados, backups testados e runbooks claros para incidentes. O investimento em alta disponibilidade deve ser proporcional ao custo do downtime: sistemas de pagamento e saude exigem investimentos muito maiores do que ferramentas internas. O importante e conhecer os trade-offs e tomar decisões conscientes sobre o nível de disponibilidade adequado para cada sistema.

Tutoriais em Video

Uncovering Stack Overflow's Shocking Architecture

Scaling Instagram Infrastructure

Consistent Hashing | Algorithms You Should Know

Top 5 Redis Use Cases

System Design BASICS: Horizontal vs. Vertical Scaling

Latency Numbers Programmer Should Know

Conceitos-chave

SPOF

Single Point of Failure, componente cuja falha derruba todo o sistema, deve ser eliminado

Failover

Troca automática para um componente redundante quando o primário falha

RTO

Recovery Time Objective, tempo máximo aceitável para recuperar o sistema após uma falha

RPO

Recovery Point Objective, quantidade maxima de dados que podem ser perdidos em uma falha

Circuit Breaker

Padrão que previne falhas em cascata bloqueando chamadas a serviços que estão falhando

Chaos Engineering

Prática de injetar falhas intencionais para testar e melhorar a resiliência do sistema

Alta Disponibilidade no Instagram

@bytebytego

Reels, Alta Disponibilidade

@bytebytego

Alta Disponibilidade no Facebook

Alta Disponibilidade no X (Twitter)

Links Uteis

O que devs dizem

Implementamos circuit breaker em todas as chamadas a serviços externos. Quando o gateway de pagamento ficou lento em um pico, o circuit breaker abriu e retornamos erros amigáveis imediatamente em vez de travar o sistema inteiro esperando timeout. Isso salvou o resto da plataforma.

A lição mais importante sobre HA: saiba seus RTO e RPO antes de projetar a arquitetura. Quando definimos formalmente que toleramos 15 minutos de downtime e perda maxima de 5 minutos de dados, ficou muito mais claro quais redundâncias eram necessárias e quais eram over-engineering.

Chaos engineering transformou nossa cultura de operações. Antes tinhamos medo de falhas. Agora as provocamos semanalmente em ambiente controlado. Ja encontramos 4 pontos únicos de falha que nunca teriamos descoberto sem isso. O sistema ficou muito mais robusto.