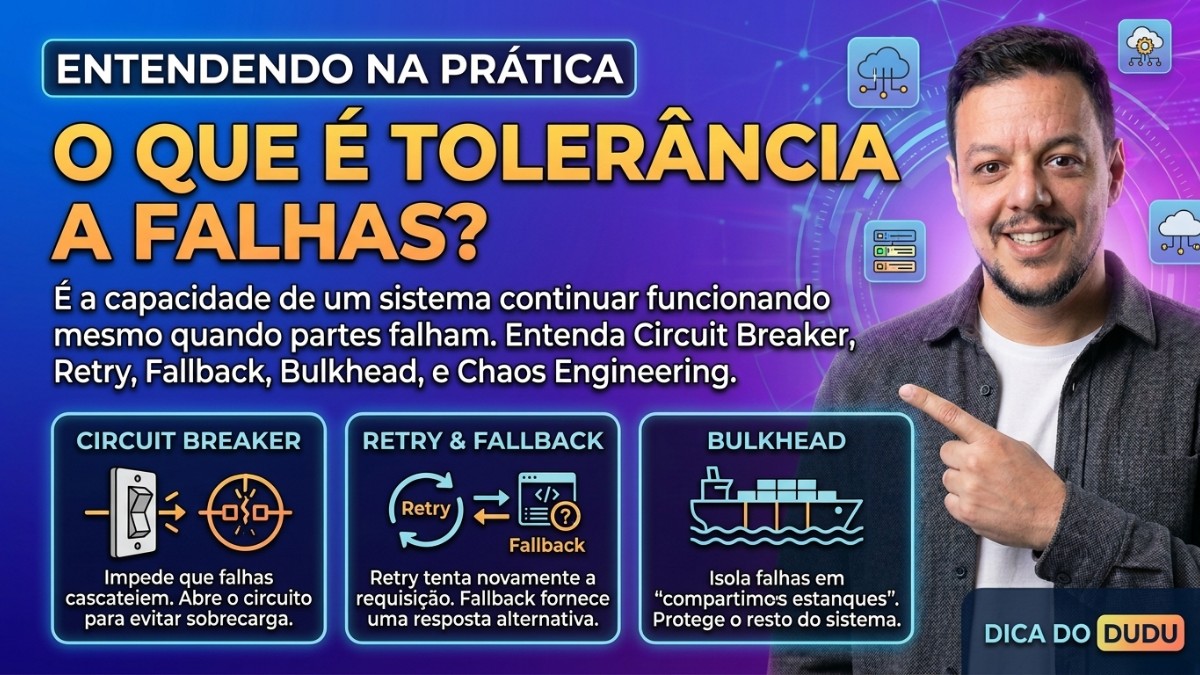

O que e tolerância a falhas

Um sistema tolerante a falhas continua operando mesmo quando componentes falham.

Tolerância a falhas e a capacidade de um sistema continuar funcionando, mesmo que de forma degradada, quando um ou mais componentes deixam de responder corretamente. Em ambientes distribuídos, falhas são inevitáveis: serviços ficam lentos, redes oscilam, bancos de dados ficam sobrecarregados. Um sistema que não foi projetado para lidar com isso pode cair por completo quando um único componente falha. A tolerância a falhas não significa eliminar falhas, significa projetar o sistema para sobreviver a elas. Isso envolve um conjunto de padrões e técnicas que limitam o impacto de uma falha e garantem que o sistema continue entregando valor mesmo em condições adversas.

Como funciona o Circuit Breaker

O Circuit Breaker interrompe chamadas para um serviço com falha antes que a falha se propague.

O padrão Circuit Breaker funciona como um disjuntor eletrico. Ele monitora as chamadas a um serviço externo e, quando detecta muitas falhas consecutivas, abre o circuito e para de fazer chamadas por um período. Durante esse tempo, retorna imediatamente um erro ou uma resposta padrão, sem esperar pelo timeout. Isso evita que uma falha em um serviço bloqueie threads, consuma recursos e se propague para outras partes do sistema. Após um tempo configurado, o circuito entra em estado semi-aberto e permite algumas chamadas de teste. Se o serviço voltou a responder, o circuito fecha e as chamadas voltam ao normal. Ferramentas como Resilience4j e Polly implementam esse padrão.

Retry e Backoff Exponencial

Tentar novamente após uma falha transitória, com intervalos crescentes entre as tentativas.

Muitas falhas em sistemas distribuídos são transitórias: uma breve sobrecarga de rede, um pico de CPU, um timeout pontual. O padrão Retry consiste em tentar novamente a operação após uma falha. Porém, fazer retry imediato pode piorar a situação se o serviço ja esta sobrecarregado. A solução e o Backoff Exponencial: cada tentativa espera um intervalo maior que a anterior, com um componente aleatório chamado jitter para evitar que vários clientes sincronizem os retries. Por exemplo: primeira tentativa após 100ms, segunda após 200ms, terceira após 400ms. Definir um número máximo de tentativas e essencial para evitar retries infinitos que bloqueiam o sistema.

Fallback e Degradação Gradual

Quando um serviço falha, entregar uma resposta alternativa em vez de um erro.

O padrão Fallback define o que fazer quando uma operação falha de forma definitiva. Em vez de propagar um erro para o usuário, o sistema entrega uma resposta alternativa: dados em cache, uma versão simplificada da funcionalidade, ou uma mensagem amigável explicando o problema. Isso e chamado de degradação gradual. Um exemplo clássico: se o serviço de recomendações de um e-commerce falhar, em vez de quebrar a página do produto, o sistema exibe uma lista genérica de produtos populares. O usuário perde um recurso, mas continua navegando. O sistema funciona de forma degradada em vez de falhar completamente. Esse princípio e central na engenhária de sistemas resilientes.

Bulkhead Pattern

Isolar recursos críticos para que a falha em um componente não afete os demais.

O padrão Bulkhead, inspirado nas divisorias estanques de navios, propoe isolar recursos entre diferentes partes do sistema. Se um serviço consome todas as threads de um pool compartilhado, os demais serviços ficam sem recursos e também falham. Com Bulkhead, cada serviço ou grupo de operações tem seu próprio pool de recursos isolado. Assim, uma falha ou sobrecarga em um componente não compromete os outros. Na prática, isso pode ser implementado com thread pools separados, semaforos ou limites de concorrência por serviço. Sistemas críticos como pagamento e checkout devem ter recursos dedicados, isolados das partes menos críticas do sistema como relatorios ou notificações.

Exemplo prático em e-commerce

Um pedido de compra deve ser concluído mesmo se o serviço de recomendações estiver fora.

Em um e-commerce, o fluxo de compra envolve múltiplos serviços: estoque, pagamento, entrega, recomendações, notificações. Com tolerância a falhas, cada chamada e protegida. O Circuit Breaker monitora o serviço de pagamento. Se ele ficar lento, o circuito abre e o usuário ve uma mensagem amigável pedindo para tentar novamente em instantes. O serviço de recomendações tem Fallback com cache. Se o serviço de notificações falhar, o evento e enfileirado para reprocessamento posterior. O estoque tem retry com backoff. O checkout tem Bulkhead com pool dedicado. O resultado e um sistema que continua vendendo mesmo com falhas parciais em componentes não críticos.

Chaos Engineering na prática

Injetar falhas intencionais para descobrir fraquezas antes que elas causem incidentes reais.

Chaos Engineering e a prática de introduzir falhas controladas em um sistema em produção para descobrir como ele se comporta sob condições adversas. A Netflix popularizou essa abordagem com o Chaos Monkey, uma ferramenta que desliga instâncias aleatorias em produção para garantir que o sistema sobreviva. A lógica e simples: se você não descobrir as fraquezas do seu sistema, elas vao se manifestar no pior momento possível. Com Chaos Engineering, você faz isso de forma controlada, com hipoteses, medições e mecanismos de rollback. Além de desligar instâncias, e possível simular latência alta, partição de rede e esgotamento de disco. O objetivo e sempre encontrar e corrigir fraquezas antes que elas causem incidentes.

Quando investir em tolerância a falhas

A criticidade do sistema e o custo da indisponibilidade determinam o quanto investir.

Nem todo sistema precisa do mesmo nível de tolerância a falhas. Para um blog pessoal, um downtime de alguns minutos e aceitável. Para um sistema de pagamentos ou monitoramento medico, qualquer falha tem impacto direto no negócio ou na segurança de pessoas. O criterio principal e o custo da indisponibilidade: quanto custa para o negócio cada minuto de sistema fora do ar? Se a resposta for alta, o investimento em tolerância a falhas se justifica. Outro fator e o grau de distribuição: quanto mais microservicos, mais pontos de falha, mais necessário adotar Circuit Breaker, Retry e Bulkhead. Sistemas monoliticos simples tem menor necessidade de padrões avançados de resiliência.

Vantagens e cuidados

Resiliência aumenta disponibilidade, mas adiciona complexidade que precisa ser gerenciada.

As principais vantagens da tolerância a falhas são: maior disponibilidade, melhor experiência do usuário em cenários de falha, redução do impacto de incidentes e mais confianca para fazer mudancas. Os cuidados envolvem a complexidade adicional: cada padrão precisa ser configurado corretamente. Um Circuit Breaker mal calibrado pode abrir com frequência desnecessária. Retries sem limite podem amplificar problemas em vez de resolve-los. Chaos Engineering em produção sem preparação pode causar incidentes reais. A recomendação e começar com os padrões mais simples, como Retry e Timeout, antes de avancar para Circuit Breaker, Bulkhead e Chaos Engineering. Monitore, meça e ajuste os parametros com base em dados reais.

Resumo

Tolerância a falhas e projetar para sobreviver ao inevitável.

Falhas em sistemas distribuídos são inevitáveis. A questão não e se vao acontecer, mas quando. Tolerância a falhas e o conjunto de práticas e padrões que permite que um sistema continue funcionando, mesmo que de forma degradada, quando partes dele falham. Circuit Breaker evita cascata de falhas. Retry com backoff trata falhas transitórias. Fallback entrega alternativas ao usuário. Bulkhead isola recursos críticos. Chaos Engineering encontra fraquezas antes dos incidentes. Aplicados em conjunto, esses padrões transformam um sistema fragil em um sistema resiliente, capaz de absorver falhas sem comprometer a experiência do usuário ou o funcionamento do negócio.

Tutoriais em Video

Mastering Chaos - A Netflix Guide to Microservices

Avoiding Microservice Megadisasters, Jimmy Bogard, NDC

Top 7 Most-Used Distributed System Patterns, ByteByteGo

What Are Microservices Really All About?, ByteByteGo

System Design Primer, Gaurav Sen

NETFLIX System Design, Software Architecture

Conceitos-chave

Circuit Breaker

mecanismo que interrompe chamadas para um serviço com falha, evitando cascata

Retry

tentar novamente após falha transiente com backoff exponencial

Fallback

resposta alternativa quando o serviço falha

Timeout

limite de tempo para evitar bloqueio por serviços lentos

Bulkhead

isolamento de recursos para evitar que falha em um serviço afete outros

Chaos Engineering

injetar falhas intencionais para descobrir pontos fracos antes que ocorram em produção

Tolerância a Falhas no Instagram

@bytebytego

Reels, Tolerância a Falhas

@bytebytego

No Facebook

Tolerância a Falhas no X (Twitter)

Links Uteis

O que devs dizem

Depois de um incidente em produção onde um serviço lento derrubou toda a nossa plataforma, implementamos Circuit Breaker em todas as chamadas externas. O próximo incidente com o mesmo serviço nem foi percebido pelos usuários. A diferença foi impressionante.

O Bulkhead foi o padrão que mais nos ajudou. Nosso serviço de relatorios consumia todas as threads e derrubava o checkout junto. Com pools separados, cada parte do sistema tem seus recursos garantidos. Simples de implementar e muito eficaz.

Chaos Engineering mudou nossa forma de pensar sobre resiliência. Antes de rodar o Chaos Monkey, achavamos que estavamos preparados. Em 30 minutos, ele encontrou 3 pontos críticos de falha que nunca teriam aparecido nos nossos testes normais.